Roboter lernen Empathie

audEERING und Hanson Robotics entwickeln Roboter mit höchster sozialer Kompetenz für den täglichen Einsatz. Einer der weltweit führenden Roboterhersteller Hanson Robotics integriert die automatisierte Emotionserkennung devAIce des deutschen KI-Unternehmens audEERING. Ein Höchstmaß an Mensch-Maschine-Interaktion eröffnet neue Chancen für den Einsatz von Robotern in der Arbeitswelt, zum Beispiel in der Pflege. Roboter erkennen die Emotionen ihres Gegenübers an der Stimme und steigern so ihre soziale Kompetenz.

Product Owner Talk mit Milenko Saponja | devAIce® Kerntechnologie

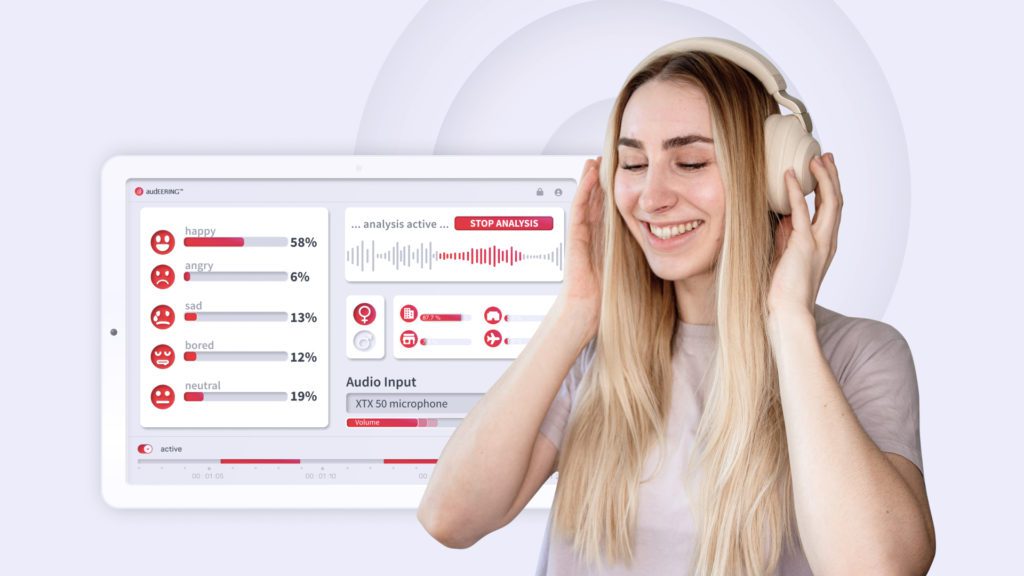

devAIce® integriert die Audioanalyse in Software und Hardware. Sie ist die Kerntechnologie von audEERING. Mit der Prodct Owner Talk Serie stellt audEERING die menschliche Intelligenz hinter dieser Technologie vor.

devAIce® Web API 4.1.0 Aktualisierung

Diese neueste Version der devAIceⓇ Web API führt aktualisierte dimensionale und kategoriale Emotionsmodelle in das Emotion (Large) Modul ein. In Benchmarks hat sich gezeigt, dass die neuen Versionen dieser Modelle deutlich robuster gegenüber Hintergrundgeräuschen und unterschiedlichen Aufnahmebedingungen sind als die Vorgängermodelle, wobei die Rechenkomplexität der Modelle unverändert bleibt.

devAIce® SDK 3.7.0 Aktualisierung

Wir freuen uns, heute die öffentliche Freigabe von devAIceⓇ SDK 3.7.0 bekannt zu geben. Dieses Update enthält mehrere bemerkenswerte Modell-Updates für die Emotions- und Alterserkennung, die Abschaffung des Sentiment-Moduls sowie zahlreiche weitere kleinere Optimierungen, Verbesserungen und Fehlerbehebungen.

devAIce Web API 4.0.0 Aktualisierung

Wir freuen uns, die Version 4.0.0 als wichtiges Update der devAIce Web API ankündigen zu können, die ab heute für Kunden verfügbar ist. Diese Version bietet vor allem eine modernisierte und vereinfachte Reihe neuer API-Endpunkte, völlig neue Client-Bibliotheken mit Unterstützung für mehr Programmiersprachen, OpenAPI-Kompatibilität sowie ein verbessertes Kommandozeilen-Interface-Tool. Darüber hinaus enthält sie aktuelle Modell-Updates und Leistungsverbesserungen aus dem letzten devAIce SDK-Release, z.B. Unterstützung für die Dimension Dominanz-Emotion und Genauigkeitsverbesserungen von bis zu 15 Prozentpunkten.

devAIce® SDK 3.6.1 Aktualisierung

Das devAIce® Team ist stolz darauf, die Verfügbarkeit von devAIce SDK 3.6.1 bekannt zu geben, das seit der letzten öffentlich angekündigten Version 3.4.0 eine Reihe von wichtigen Erweiterungen, spannenden neuen Funktionen und kleineren Korrekturen enthält. Dieser Blogbeitrag fasst die wichtigsten Änderungen zusammen, die seither im devAIce® SDK eingeführt wurden.

Voice AI nimmt Emotionen in jeder Welt wahr

Menschliche Interaktion basiert auf einer Sprache, auf einem Kontext, auf einem Weltwissen, das wir teilen. Als Voice AI-Unternehmen wissen wir, dass Emotionen der Schlüsselfaktor sind. Emotionaler Ausdruck bringt uns in Bewegung, schafft Bewegung und eine kollektive Reaktion. Er ist ein Schlüsselfaktor in der Gesellschaft. Er ist die Grundlage für alle Entscheidungen, die wir treffen. Bei der Schaffung einer virtuellen Realität, neuer Dimensionen und erweiterter Erfahrungen darf dieser Schlüsselfaktor nicht fehlen.

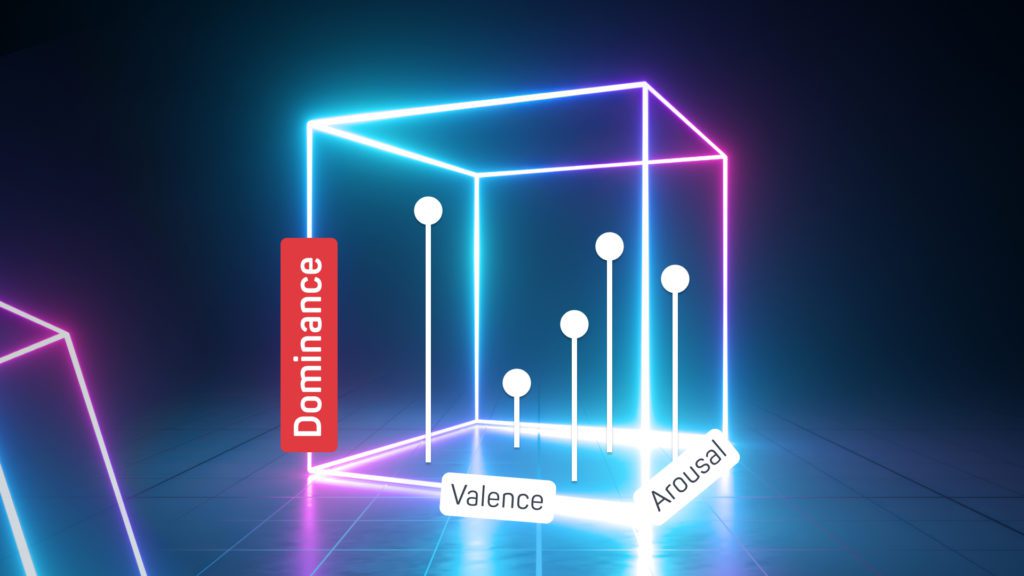

Schließen der Valenzlücke bei der Erkennung von Emotionen

2021 war ein spannendes Jahr für unsere Forscher, die sich mit der Erkennung von Emotionen aus Sprache beschäftigen. Dank der jüngsten Fortschritte bei transformatorbasierten Architekturen haben wir zum ersten Mal Modelle entwickelt, die die Valenz mit ähnlich hoher Genauigkeit vorhersagen wie die Erregung.

Neue Updates für audEERINGs Kerntechnologie: devAIce SDK/Web API 3.4.0

Wir sind stolz darauf, mit der neuesten Version 3.4.0 des devAIce TM SDK/Web API eine neue Klasse von Emotionsmodellen der nächsten Generation für devAIce ankündigen zu können.

Der Mensch in der Schleife - Wie schaffen wir KI?

Bei der Entwicklung von KI-Technologie, wie wir sie bei audEERING betreiben, müssen wir unsere menschliche Wahrnehmung verstehen. Die alltägliche Wahrnehmung ermöglicht es uns, den emotionalen Zustand unseres Kommunikationspartners in verschiedenen Situationen zu erkennen. Im Prozess des menschlichen maschinellen Lernens müssen wir dem Algorithmus den nötigen Input geben. Wie schaffen wir bei audEERING KI?

ERIK - Emotionserkennung für die Autismus-Therapie

Das Erkennen und Wahrnehmen von Gefühlsäußerungen ist ein wesentlicher Bestandteil der menschlichen Kommunikation. Um die sozio-emotionalen Kommunikationsfähigkeiten autistischer Kinder zu entwickeln, muss die Therapie darauf ausgerichtet sein. Im Rahmen des ERIK-Projekts wird eine neue Form der Therapie entwickelt.