Wir sind stolz darauf, mit der neuesten Version 3.4.0 von devAIce TM eine neue Klasse von Emotionsmodellen der nächsten Generation ankündigen zu könnenTM SDK/Web API.

devAIce TM - Audioanalyse für Hardware und Software

devAIceTM ist die Kerntechnologie von audEERING, auf der jede weitere Idee wächst. Sie ist darauf ausgelegt, Emotionen, akustische Szenen und viele andere Merkmale aus Audio zu erkennen. Sowohl in Echtzeit als auch für jedes beliebige Produkt. Die KI-Modelle arbeiten auch bei begrenzter CPU-Leistung solide. audEERINGs Kerntechnologie kann über 6.000 Sprachparameter in Echtzeit erfassen. Unsere Forscher nutzen modernste KI-Methoden wie tiefe neuronale Netze und unüberwachtes Lernen. Wir verarbeiten nur qualitativ hochwertige Daten, um unsere Modelle zu optimieren.

Was ist neu in devAIce TM

- Neue Familie von Emotionsmodellen

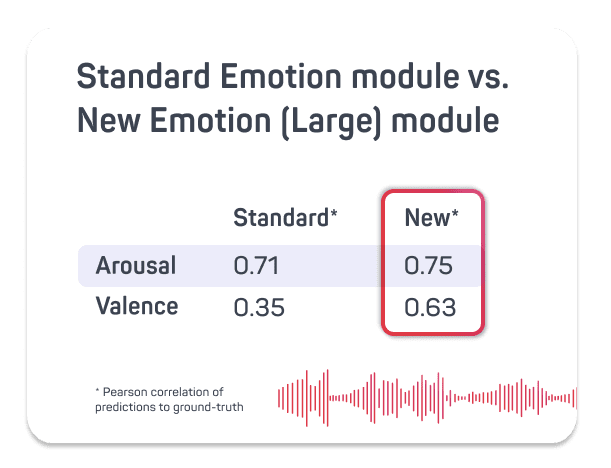

Eine neue Klasse von Emotionsmodellen der nächsten Generation wird in devAIceTM als Teil des neu eingeführten Moduls Emotion (Large) bereitgestellt. Durch die Nutzung der neuesten Fortschritte in der Deep Learning-basierten Audioklassifikation können diese Modelle unser Standard-Emotionsmodul deutlich übertreffen.

Vergleicht man unsere Standard-Emotionsmodelle mit den neuen Modellen auf dem MSP-Podcast Testset, so stellt man einen dramatischen Anstieg der Vorhersagegenauigkeit der Valenz und eine deutliche Steigerung der Erregungsschätzung fest:

- Emotionsfusion aus Sprache und Text

Eigenständige Modelle zur Emotionserkennung aus Audio und zur Sentimentanalyse aus englischem Text waren bereits in devAIceTM verfügbar. Mit der neuen Version von devAIceTM führen wir das neue Modul Multi-Modal Emotion ein. Es bietet ein dediziertes, einzelnes Modell, das Audio und Text als Input akzeptiert und die Daten zu einer einzigen kombinierten Emotionsvorhersage zusammenführt.

- Überprüfung der Sprecher

Die neueste Version von devAIceTM unterstützt die Verifizierung von Sprechern über das Modul Speaker Verification . Mit dieser Funktion können Sie feststellen, ob ein Sprecher mit einem oder mehreren zuvor registrierten Sprechern übereinstimmt. Ein möglicher Anwendungsfall für diese Funktionalität ist die gezielte Datenerfassung, bei der nur die Sprache eines bestimmten Sprechers verarbeitet werden soll und alle anderen Stimmen ignoriert werden.

- Intonation

Wir erweitern das Prosody-Modul um eine neue Metrik zur Analyse und Bewertung der Intonation der menschlichen Sprache. Sie können diese Ausgabe verwenden, um zu beurteilen, wie monoton oder lebhaft eine Person spricht.

Auftrag und Vision von audEERING

audEERING unterstützt und entwickelt die Standardversion dieser Modelle für ressourcenarme Umgebungen weiter. Insbesondere setzen wir uns dafür ein, das volle Potenzial der Stimme als natürliche Ressource auszuschöpfen, um einen Mehrwert für die Menschen und ihren Alltag zu schaffen.

Wo kann ich weitere Informationen erhalten? Haben Sie Fragen zu den Updates von devAIceTM? Möchten Sie die neueste Version in die Hände bekommen?

Für weitere Informationen wenden Sie sich bitte an unsere Customer Experience Managerin Sylvia Szylar: sszylar@audeering.com