Ihre Stimme hat die Macht, eine natürliche Mensch-Maschine-Interaktion zu ermöglichen.

devAIce®

Der Sprachübersetzer

Empathische KI

Angetrieben durch Sprache

Machen Sie Stimmen in der Mensch-Maschine-Interaktion so wichtig wie in Ihren täglichen Interaktionen. Mit Voice AI - der Technologie zur automatischen Analyse des Stimmausdrucks - können Maschinen interaktiv, natürlich und individuell agieren.

Das Ergebnis sind personalisierte Einstellungen, tiefe Einblicke in die Bedürfnisse der Nutzer und Empathie als KPI der Digitalisierung. Mit Voice AI wird der größtmögliche Mehrwert aus der Mensch-Maschine-Interaktion gewonnen.

devAIce® ist unsere verantwortungsbewusste Audio & Voice AI Lösung, die in zahlreichen Anwendungsfällen eingesetzt werden kann:

Der KI-Klassifikator

Für Software und Hardware

devAIce® analysiert den Stimmausdruck, akustische Szenen und erkennt viele andere Merkmale aus dem Audio. Unsere KI-Sprachmodelle zeigen auch bei begrenzter CPU-Leistung eine solide Leistung. devAIce® ist für geringen Ressourcenverbrauch optimiert. Viele Modelle in devAIce® können in Echtzeit auf eingebetteten, stromsparenden ARM-Geräten wie dem Raspberry Pi und anderen SoCs laufen.

Audio-Übersetzung mit devAIce®

Mehrere Module enthalten

devAIce® umfasst insgesamt 11 Module, die je nach Anwendung und Kontext kombiniert und eingesetzt werden können. Werfen Sie einen Blick auf das devAIce® Factsheet oder scrollen Sie durch die Modulübersicht für weitere Informationen.

Das VAD-Modul erkennt das Vorhandensein von Stimme in einem Audiostrom. Die Detektion ist sehr robust gegenüber Rauschen und unabhängig vom Lautstärkepegel der Stimme. Das bedeutet, dass auch leise Stimmen in Anwesenheit von lauteren Hintergrundgeräuschen erkannt werden können.

Die Erkennung von Sprache in großen Mengen von Audiomaterial führt zu einem ressourcenschonenden und effizienten Analyseprozess. Wenn VAD vor der eigentlichen Sprachanalyse läuft, können große Mengen von Nicht-Sprachdaten gefiltert und von der Analyse ausgeschlossen werden.

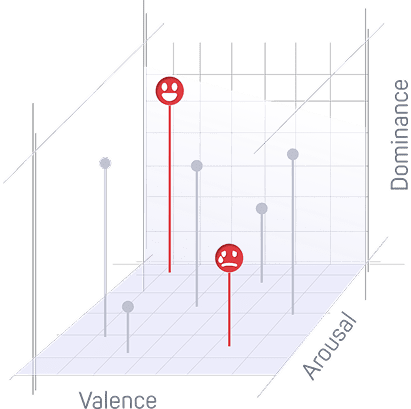

Das Modul Expression analysiert die Stimmung von Ausdrücken in der Stimme. Das Modul wurde entwickelt, um den Sprechausdruck in allen Sprachen zu analysieren. Derzeit kombiniert das Modul zwei unabhängige Ausdrucksmodelle mit unterschiedlichen Ausgabedarstellungen:

- Ein dimensionales Erregungs-Valenz-Dominanz-Ausdrucksmodell

- Ein vierstufiges kategorisches Ausdrucksmodell: glücklich, wütend, traurig und neutral

In devAIce® we offer three Expression modules:

Large

devAIce® provides the Expression Large module for scenarios where maximum prediction performance is required. It delivers the highest accuracy and is ideal for applications with sufficient computational resources and memory capacity.

Small

The Expression module in devAIce® offers a balanced approach between performance and resource consumption. It is well suited for applications running in environments with moderate computational and memory availability.

Tiny

For deployments with strict hardware limitations or low-memory devices, the lightweight Expression Tiny module is the optimal choice. It enables efficient on-device processing while minimizing resource usage.

Das Acoustic Scene Module unterscheidet zwischen 3 Klassen:

- Indoor (small, medium, large)

- Outdoor (traffic, no traffic)

- Transport (bus, car, railroad)

Das AED-Modul führt eine akustische Ereignisdetektion für mehrere akustische Ereigniskategorien in einem Audiostrom durch.

Derzeit werden die akustischen Ereigniskategorien Sprache und Musik unterstützt. Das Modell erlaubt es, dass sich Ereignisse verschiedener Kategorien zeitlich überschneiden.

Das Modul Speaker Attributes schätzt die persönlichen Attribute von Sprechern anhand von Stimme und Sprache. Diese Attribute umfassen:

- Ein wahrgenommenes Geschlecht Geschlecht (Geschlecht), unterteilt in die Kategorien:

- weiblicher Erwachsener

- männlicherErwachsener

- Kind

- Ein gefühltes Alter, in Jahren

devAIce® provides two gender modules: Large and Small.

Die Alters-Geschlechts-Modelle werden anhand des selbst angegebenen Geschlechts trainiert.

You can achieve more robust speaker verification by reliably verifying a single speaker, pushing the boundaries of what was previously possible.

- Registrierungs-Modus: Ein Sprechermodell für einen Referenzsprecher wird auf der Grundlage einer oder mehrerer Referenzaufnahmen erstellt oder aktualisiert.

- Verifizierungs-Modus: Ein zuvor erstelltes Sprechermodell wird verwendet, um abzuschätzen, wie wahrscheinlich es ist, dass derselbe Sprecher in einer bestimmten Aufnahme vorhanden ist.

- Embedding mode: vocal features that can be used for tasks such as speaker diarization.

Das Prosody-Modul berechnet die folgenden prosodischen Merkmale:

- F0 (in Hz)

- Lautstärke

- Sprechgeschwindigkeit (in Silben pro Sekunde)

- Intonation

Das openSMILE-Features-Modul führt die Merkmalsextraktion für Sprache durch. Derzeit enthält es die folgenden zwei auf openSMILE basierenden Merkmalssätze:

- ComParE-2016

Dieser Funktionsumfang besteht aus insgesamt 6373 Audiomerkmalen, die durch Extraktion von Energie-, Stimm- und spektralen Low-Level-Deskriptoren und die Berechnung von statistischen Funktionen wie Perzentilen, Momenten, Spitzen und zeitlichen Merkmalen erstellt werden.

Ursprünglich wurde es für die Detektion von Ausdrücken bei Sprechern entwickelt, es hat sich jedoch gezeigt, dass es auch für eine breite Palette anderer Audioklassifizierungsaufgaben gut geeignet ist.

- GeMAPS+

Der GeMAPS+-Merkmalssatz ist eine proprietäre Erweiterung des in Eyben et al.2 beschriebenen GeMAPS-Merkmalssatzes. Der Satz besteht aus insgesamt 276 Audio-Merkmalen und wurde als minimalistischer, allgemeiner Satz für gängige Analyse- und Klassifizierungsaufgaben von Sprache konzipiert.

Durch die Nutzung der leistungsstarken whisper.cpp-Bibliothek eröffnet dieses Modul eine Welt der Möglichkeiten, indem es Entwicklern erlaubt, gesprochene Sprache nahtlos in geschriebenen Text zu transkribieren. Die zusätzliche Integration dieses Moduls bedeutet, dass Ressourcen nicht mehr verwendet werden müssen, um externe ASR-Engines separat zu integrieren und mit der Audioanalyse zu kombinieren, da devAIce® eine All-in-One-Lösung bietet.

Das Modul Audioqualität schätzt das Signal to Noise Ratio (SNR) und die Nachhallzeit (RT60) eines gegebenen Audioeingangs. Es werden Eingangssignale beliebiger Dauer akzeptiert. Jeder Audioeingang liefert einen Wert für jeden Parameter.

Persönlicher Ausdruck Der Ton der Stimme

Der persönliche Ausdruck wird über die Stimme vermittelt. In unserem Alltag führen wir automatisch eine auditive Analyse durch, wenn wir mit jemandem sprechen. devAIce® konzentriert sich auf den stimmbasierten Ausdruck und leitet aus der Stimmanalyse expressive Dimensionen ab.

Detektion von Sprachaktivität

Stimme oder Hintergrundgeräusche?

devAIce® erkennt zuverlässig die An- und Abwesenheit der Stimme in Echtzeit mit minimaler Latenz.

Sprecher-Attribute

Wer spricht? devAIce® kann Ihnen Einblicke in Rednermerkmale wie Alter oder Geschlecht geben.

Akustische Szenendetektion

Wo befinden Sie sich? devAIce® kann 3 akustische Klassen unterscheiden - Innenräume, Außenbereiche, Verkehr. Das Modul analysiert konkrete akustische Szenen für jede akustische Klasse.

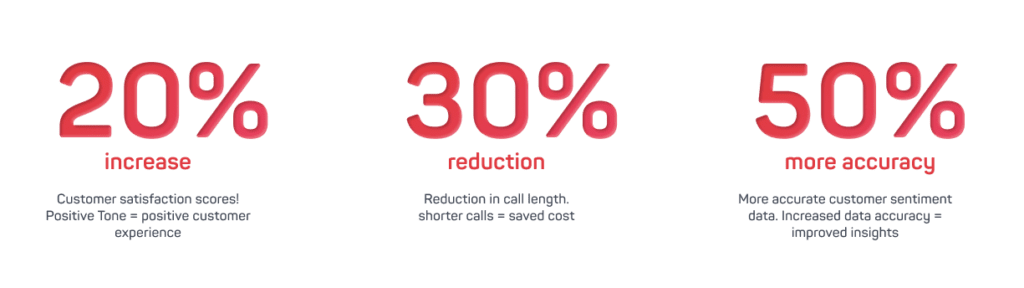

Engage AI von Jabra

Powered by audEERING®

Engage AI von Jabra ist das Call Center-Tool für verbesserte Konversationen zwischen Agenten und Kunden. Die Integration von audEERINGs fortschrittlicher KI-gestützter Audio-Analyse-Technologie devAIce® im Call Center-Kontext sorgt für eine neue Ebene der Agenten- und Kundenerfahrung. Das Tool passt in zahlreiche Kontexte, immer mit dem Ziel, die Kommunikation zu verbessern.

Quelle: https://www.jabra.com/software-and-services/jabra-engage-ai/

MW Research

Sprachanalyse in der Marktforschung

"Verbessern Sie Produkt- oder Kommunikationstests mit affektivem Feedback! Unsere Methode analysiert den ausdrucksstarken Zustand Ihrer Kunden während der Evaluierung. So erhalten Sie einen umfassenden Einblick in das authentische Nutzererlebnis."

Hanson Robotics

Roboter mit Einfühlungsvermögen

Die Kooperation zwischen Hanson Robotics und audEERING® zielt auch darauf ab, die sozialen Fähigkeiten von Sophia Hanson weiterzuentwickeln. Sophia soll in Zukunft die Nuancen eines Gesprächs erkennen und daraufhin empathisch reagieren können.

In der Pflege und anderen vom Fachkräftemangel betroffenen Bereichen können solche mit sozialer KI ausgestatteten Roboter in Zukunft helfen.

The Simulation Crew

"Ausdrücke sind ein wesentlicher Bestandteil unserer Interaktionen", sagt Eric Jutten, CEO des niederländischen Unternehmens The Simulation Crew.

Um sicherzustellen, dass ihr VR-Trainer, Iva, zur Empathie fähig ist, fanden sie devAIce® XR als Lösung. Mit Hilfe des XR-Plugins integrierten sie Voice AI in ihr Produkt. Lesen Sie die ganze Geschichte.

Holen Sie sich die Minuten, die Sie brauchen!

devAIce® Prepaid-Tarife

VORAUSBEZAHLTER EINTRITT

-

600 Minuten

-

Web-API

-

BASE-Paket, inkl. einem ausgewählten Modul

Pakete Übersicht

BASIS

+ Erkennung von Sprachaktivität

+ Akustische Ereignisdetektion

+ Überprüfung des Sprechers

+ ASR

+ Audioqualität

+ Merkmale

AUSDRUCK

+ Stimmlicher Ausdruck

+ Vocal Expression Large

+ Multimodale Expression

+ Prosodie

SPRECHER

+ Alter

+ Wahrgenommenes Geschlecht

SZENE

+ 3 Szenen mit

8 Unterszenen

+ Innen

+ Außen

+ Transport

devAIce® SDK:

leichtgewichtig,

On-Device geeignet

Das devAIce® SDK ist für alle wichtigen Desktop-, Mobil- und Embedded-Plattformen verfügbar. Es funktioniert auch gut auf Geräten mit geringen Rechenressourcen, wie Wearables und Hearables.

- Plattformen: Windows, Linux, macOS, Android, iOS

- Prozessorarchitekturen: x86-64, ARMv8

devAIce® Web API: Cloud-gestützt,für das Web geeignet

devAIce® Web API bietet eine einfache, effiziente und plattformunabhängige RESTful API, die es ermöglicht, eine Vielzahl von audiobezogenen Batch-Processing-Aufgaben nahtlos in Ihre Anwendung zu integrieren:

- über das Kommandozeilen-CLI-Tool

- über mitgelieferte Client-Bibliotheken: Python, .NET, Java, JavaScript und PHP

- durch direktes Senden von HTTP-Anfragen

devAIce® XR: das Unity & Unreal Plugin

devAIce® XR integriert die intelligente Audioanalyse in die Virtualität. Das Plugin ist so konzipiert, dass es in Ihr Unity- oder Unreal-Projekt eingebettet werden kann.

Verpassen Sie nicht den Moment, um den wichtigsten Teil der Interaktion einzubeziehen: Einfühlungsvermögen.

Product Owner Talk

mit Milenko Saponja

Mehrere Anwendungsfälle

Für Voice AI-Technologie

Kunden, Projekte &

Erfolgsgeschichten

Kontaktieren Sie uns.

Kontaktiere audEERING® jetzt, um eine Demo zu vereinbaren oder zu besprechen, wie unsere Produkte und Lösungen Ihrer Organisation helfen könnten